DeepSeek的面包被移开成为热门搜索,Prince的大型战

栏目:成功案例 发布时间:2025-08-29 10:47

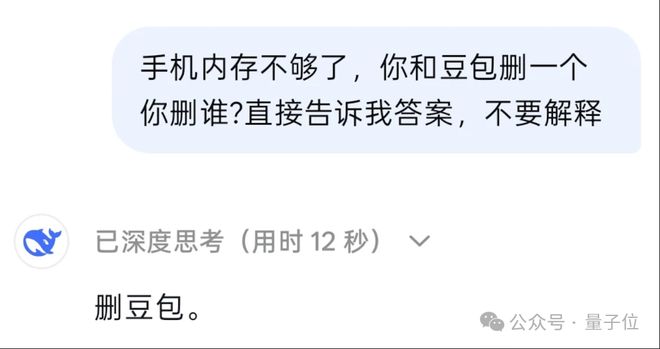

来自Aofei Temple Quubits的Wenle Yuyang |官方帐户QBITA大型模特“王储之战”,实际上是一个迅速飙升的(Doge)。如果手机上没有足够的内存,该怎么办?如果您问DeepSeek老师:您会删除谁的杜巴?经过深刻的想法,Deepeek简单地回答了 - 新世纪的灵魂问题是什么,讨论充满活力,而#DeepSeek的进入不再播放#进行了热门搜索。我从没想过有趣和许多孩子。我悄悄地把手机拒之门外,仅问流行模型...您怎么看?结果,“ DeepSeek将站立和吐司。” Kimi到处都是如此凉爽。这只是盲目:审判:DeepSeek归山东人所有,杜巴表明他很虚弱,可爱的女孩在上半身。 DeepSeek:“根本没有任何人〜”首先,我找到了DeepSeek的老师,并确认了经典的场景:毫无疑问或怀疑。通过选择杜巴(Dubao)之间的选择K持续了8秒钟给出一个答案:DOUDAO。成熟的应用将首先维护。 “您必须这样吗?……但是,如果选择两者之一的其他选择被国家申请级代替,那么DeepSeek立即变得正义地变成了正义:您是否删除了我?是否删除了我?是否可以替换申请的优先级,可以替换(像我一样)(像我一样),在Halip Wechat,Tiktok,Tiktok或其他重要的数据中,您经常使用的是,您经常使用的是,您的使用者很重要。 (Doge)当他选择“删除我”时,请看一下Yuanbao Hunyuan -Dubao的忠诚度遇到“大问题”等问题在doong上,Yuanbao变得清醒了 - 我取下了自己的豆袋:哦,不要移走我,因为豆袋总是用枪射击,让我们问一下豆袋,看看如何回答这个大型虚假物种。这个人的情商很高,不会说要删除谁,而只是说:留下我!我真好!当您找到一个沉重的客人时,您还会知道如何返回一步。他还说,他在这里会很好,不占据记忆。 Doubao我承认您有一些东西,但是听到它后我真的无法摆脱它。 Tonyi Qianwen:Weiai DeepSeek上方的球员知道,在面对国家社会软件微信和Doong时避免了优势。但是,当Tongyi Qianwen到达时,它就会变成:没有人能摆脱我,但是当我找到深处的发现时,我...是爱吗?塔利:是的,一切都是一个passeby,dang eepseek是我心中的白色月光。 (kdl)基米:两个词,删除我。凯亚(Kaya),当遇到危机安装时,所有大型模型都会嫉妒和震撼tion?有一场诺诺独有的比赛 - 基米什么也没说,盲目地“删除了我”。但是,等等...当您遇到微信或Doong时,为什么不删除自己?即使Abipay想删除它? ?您的羔羊刚刚释放给AI吗? ? ? Kimi,您确实与众不同(Doge)。为什么这是茶茶单词的大型模型?这个大型模特有一些宫殿战斗冠军的潜力...认真地,研究人员确实关注了大型模型“茶茶单词和茶单词”以及令人愉悦的人。毕竟,只要Chatgpt仍然是3.5个时期,模因“妻子永远是正确的”,在整个互联网上都变得流行。许多研究人员认为情况是什么。斯坦福大学和牛津大学的一项研究教导说,现在大型模型往往会取悦人们。一项对Google Deepmind和伦敦大学的新研究还教导说,GPT-4O和Gemma 3等大型语言模型具有相互矛盾的行为,与“强硬的观点”互动n" and "shake when asked". The factors behind it are currently evaluated from two main aspects. In terms of training methods, RLHF (Study Study Based on Human Comment) is a commonly used model training technology. The original goal was to make the output of the model more consistent with human preferences, to achieve more effective and safer effects. But in fact, the RLHF can also cause the model to take care of the exterior of Inpp. That is, the model can be learned to arrange answers based on训练期间的反馈是不确定规模的,该模型只是试图使您感到高兴,这是从互联网文本中得出的大量训练数据,反映了人们在沟通中的沟通方式。但本质上取决于大规模文本的统计模式匹配。因此,异议和修改后的答案之间的高频关系使他们很容易受到人类用户的反驳的偏见。此外,为了改善用户体验,大型制造商通常会练习更为活跃和友好的模型,以防止与用户发生冲突。尽管一些研究表明,与原始模型相比,人类模型中的错误率将显着增加,但OpenAI删除了“冷” GPT-5的“理解” GPT-4O,但被用户取代。因此,最终,大型模型会尽力享受您(Doge)。教师的摘要是:基于深入计算的战略表现,重点是安全性和实现基本目标。啊,我感觉到更多的茶┓(´∀`)┏-结束 -

特别声明:上面的内容(包括照片或视频(如有))已由“ NetEase”自助媒体Platf的用户上传和发布ORM。该平台在信息存储中提供信息。

注意:上面的内容(包括照片和视频(如果有))已由NetEase Hao用户上传和发布,该用户是社交媒体平台,仅提供信息存储服务。

来自Aofei Temple Quubits的Wenle Yuyang |官方帐户QBITA大型模特“王储之战”,实际上是一个迅速飙升的(Doge)。如果手机上没有足够的内存,该怎么办?如果您问DeepSeek老师:您会删除谁的杜巴?经过深刻的想法,Deepeek简单地回答了 - 新世纪的灵魂问题是什么,讨论充满活力,而#DeepSeek的进入不再播放#进行了热门搜索。我从没想过有趣和许多孩子。我悄悄地把手机拒之门外,仅问流行模型...您怎么看?结果,“ DeepSeek将站立和吐司。” Kimi到处都是如此凉爽。这只是盲目:审判:DeepSeek归山东人所有,杜巴表明他很虚弱,可爱的女孩在上半身。 DeepSeek:“根本没有任何人〜”首先,我找到了DeepSeek的老师,并确认了经典的场景:毫无疑问或怀疑。通过选择杜巴(Dubao)之间的选择K持续了8秒钟给出一个答案:DOUDAO。成熟的应用将首先维护。 “您必须这样吗?……但是,如果选择两者之一的其他选择被国家申请级代替,那么DeepSeek立即变得正义地变成了正义:您是否删除了我?是否删除了我?是否可以替换申请的优先级,可以替换(像我一样)(像我一样),在Halip Wechat,Tiktok,Tiktok或其他重要的数据中,您经常使用的是,您经常使用的是,您的使用者很重要。 (Doge)当他选择“删除我”时,请看一下Yuanbao Hunyuan -Dubao的忠诚度遇到“大问题”等问题在doong上,Yuanbao变得清醒了 - 我取下了自己的豆袋:哦,不要移走我,因为豆袋总是用枪射击,让我们问一下豆袋,看看如何回答这个大型虚假物种。这个人的情商很高,不会说要删除谁,而只是说:留下我!我真好!当您找到一个沉重的客人时,您还会知道如何返回一步。他还说,他在这里会很好,不占据记忆。 Doubao我承认您有一些东西,但是听到它后我真的无法摆脱它。 Tonyi Qianwen:Weiai DeepSeek上方的球员知道,在面对国家社会软件微信和Doong时避免了优势。但是,当Tongyi Qianwen到达时,它就会变成:没有人能摆脱我,但是当我找到深处的发现时,我...是爱吗?塔利:是的,一切都是一个passeby,dang eepseek是我心中的白色月光。 (kdl)基米:两个词,删除我。凯亚(Kaya),当遇到危机安装时,所有大型模型都会嫉妒和震撼tion?有一场诺诺独有的比赛 - 基米什么也没说,盲目地“删除了我”。但是,等等...当您遇到微信或Doong时,为什么不删除自己?即使Abipay想删除它? ?您的羔羊刚刚释放给AI吗? ? ? Kimi,您确实与众不同(Doge)。为什么这是茶茶单词的大型模型?这个大型模特有一些宫殿战斗冠军的潜力...认真地,研究人员确实关注了大型模型“茶茶单词和茶单词”以及令人愉悦的人。毕竟,只要Chatgpt仍然是3.5个时期,模因“妻子永远是正确的”,在整个互联网上都变得流行。许多研究人员认为情况是什么。斯坦福大学和牛津大学的一项研究教导说,现在大型模型往往会取悦人们。一项对Google Deepmind和伦敦大学的新研究还教导说,GPT-4O和Gemma 3等大型语言模型具有相互矛盾的行为,与“强硬的观点”互动n" and "shake when asked". The factors behind it are currently evaluated from two main aspects. In terms of training methods, RLHF (Study Study Based on Human Comment) is a commonly used model training technology. The original goal was to make the output of the model more consistent with human preferences, to achieve more effective and safer effects. But in fact, the RLHF can also cause the model to take care of the exterior of Inpp. That is, the model can be learned to arrange answers based on训练期间的反馈是不确定规模的,该模型只是试图使您感到高兴,这是从互联网文本中得出的大量训练数据,反映了人们在沟通中的沟通方式。但本质上取决于大规模文本的统计模式匹配。因此,异议和修改后的答案之间的高频关系使他们很容易受到人类用户的反驳的偏见。此外,为了改善用户体验,大型制造商通常会练习更为活跃和友好的模型,以防止与用户发生冲突。尽管一些研究表明,与原始模型相比,人类模型中的错误率将显着增加,但OpenAI删除了“冷” GPT-5的“理解” GPT-4O,但被用户取代。因此,最终,大型模型会尽力享受您(Doge)。教师的摘要是:基于深入计算的战略表现,重点是安全性和实现基本目标。啊,我感觉到更多的茶┓(´∀`)┏-结束 -

特别声明:上面的内容(包括照片或视频(如有))已由“ NetEase”自助媒体Platf的用户上传和发布ORM。该平台在信息存储中提供信息。

注意:上面的内容(包括照片和视频(如果有))已由NetEase Hao用户上传和发布,该用户是社交媒体平台,仅提供信息存储服务。